OpenWebUI + vLLM : déployer des LLMs privés en entreprise — guide complet

Les projets IA ne sont plus des expérimentations. Les entreprises veulent des assistants internes, des copilotes documentaires, des moteurs d’analyse.

La vraie question n’est plus “peut-on le faire ?”. C’est “comment le faire proprement ?”.

Entre OpenWebUI, LLM privés via vLLM, modèles open source type GPT-OSS et contraintes de souveraineté, les décisions structurantes arrivent très vite. Et mal cadrées, elles créent plus de dette que de valeur.

Voici les bases à comprendre avant de lancer un projet IA en entreprise.

1. OpenWebUI : industrialiser l’accès aux modèles

Brancher une API externe dans un outil interne, c’est simple. Structurer un environnement multi-modèles utilisable par les métiers, beaucoup moins.

OpenWebUI joue un rôle clé : fournir une interface unifiée au-dessus des modèles.

On sépare l’expérience utilisateur du moteur IA. On centralise les accès. On garde la possibilité de changer de modèle sans tout réécrire.

C’est une logique plateforme, pas un POC bricolé.

2. SaaS, open source ou hybride : choisir en conscience

Trois approches dominent.

Les API SaaS : rapides à déployer, peu d’infrastructure, dépendance forte. Les modèles open source auto-hébergés : plus de contrôle, plus de complexité. Les architectures hybrides : compromis entre agilité et souveraineté.

Il n’y a pas de bon choix universel. Il y a un choix cohérent avec votre stratégie cloud et vos contraintes réglementaires.

La question de la souveraineté devient centrale. Nous l’avons détaillée dans cet article sur la souveraineté des données et la stratégie cloud en Europe.

3. LLM privés avec vLLM : la réalité opérationnelle

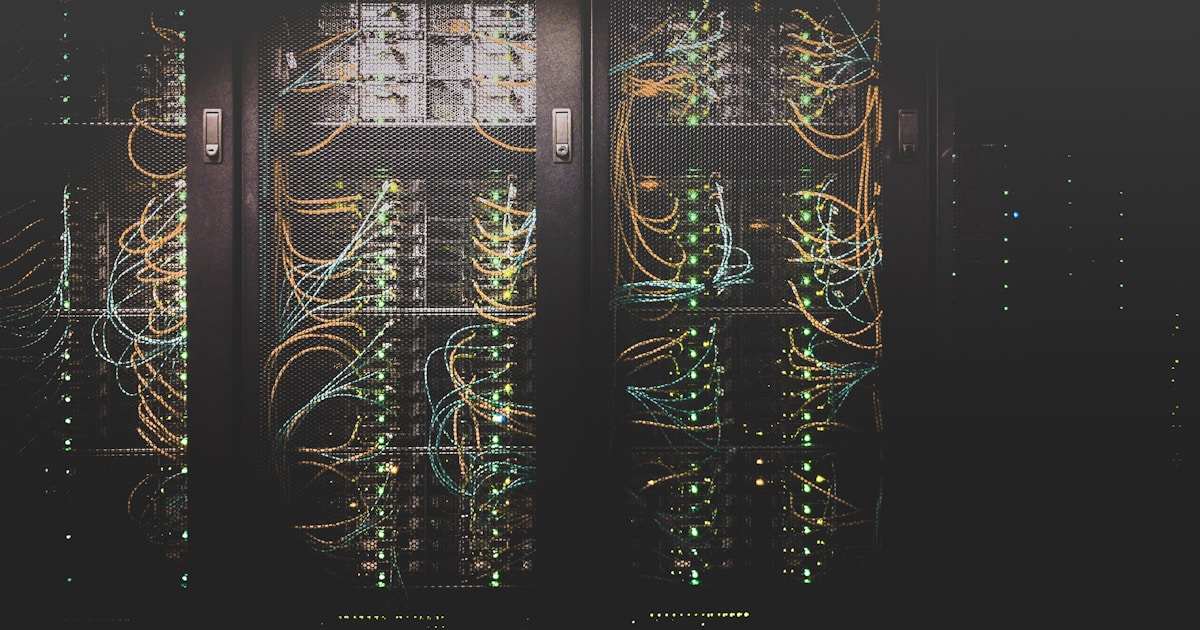

Héberger un LLM en interne paraît séduisant. Mais le vrai sujet n’est pas le modèle, c’est l’infrastructure.

vLLM permet de servir des modèles open source de manière performante, en optimisant l’usage GPU et la latence. Sans ce type de moteur, les coûts explosent vite.

Déployer un LLM privé implique :

Une infra adaptée Un monitoring sérieux Une gestion fine des versions modèles Une sécurité maîtrisée

Ce n’est pas un simple conteneur à lancer. C’est une décision d’architecture.

4. GPT-OSS : opportunité et vigilance

Les modèles open source de nouvelle génération, parfois qualifiés de GPT-OSS, rebattent les cartes.

Ils offrent plus d’indépendance. Ils permettent un hébergement souverain. Ils ouvrent la voie au fine-tuning avancé.

Mais ils ne sont pas “gratuits”. Le coût se déplace vers l’infrastructure, l’exploitation et les compétences.

Le contrôle augmente. La responsabilité aussi.

5. Le point critique : la maturité data

Le frein principal n’est pas technique. Il est organisationnel.

Beaucoup d’entreprises ne savent pas précisément :

Quelles données sont exploitables Qui en est responsable Si elles sont fiables Si elles peuvent être exposées à un LLM

Un modèle amplifie la qualité des données. Il amplifie aussi leurs défauts.

Sans gouvernance data, un projet IA devient vite un risque.

6. L’accompagnement et les compétences Pantagram

Un projet IA touche l’IT, la data, les métiers, la sécurité et le juridique.

Dans nos missions de transition numérique chez Pantagram, nous sommes régulièrement confrontés à ce décalage : une forte ambition métier, mais un manque de structuration technique et data pour soutenir un déploiement IA solide.

Nous accompagnons des clients et des groupes sur :

La définition des cas d’usage prioritaires Le choix entre API externes et modèles locaux Le déploiement de LLM privés via vLLM La mise en place d’architectures hybrides et souveraines La structuration de la gouvernance data

Notre rôle n’est pas de “brancher un modèle”. Il est de construire une architecture IA cohérente avec la stratégie cloud, les contraintes réglementaires et la réalité opérationnelle.

L’objectif est simple : transformer l’IA en capacité durable, pas en démonstrateur.

Ouvrir le chantier

Déployer de l’IA en entreprise n’est pas un choix d’outil. C’est un choix d’architecture et de maturité.

OpenWebUI, vLLM et les modèles open source rendent le déploiement possible. Mais la différence se fait sur la gouvernance, la stratégie cloud et la compréhension des données.

L’IA n’est pas un plugin. C’est une brique plateforme.

La vraie question devient alors : votre organisation est-elle prête à l’intégrer comme telle ?